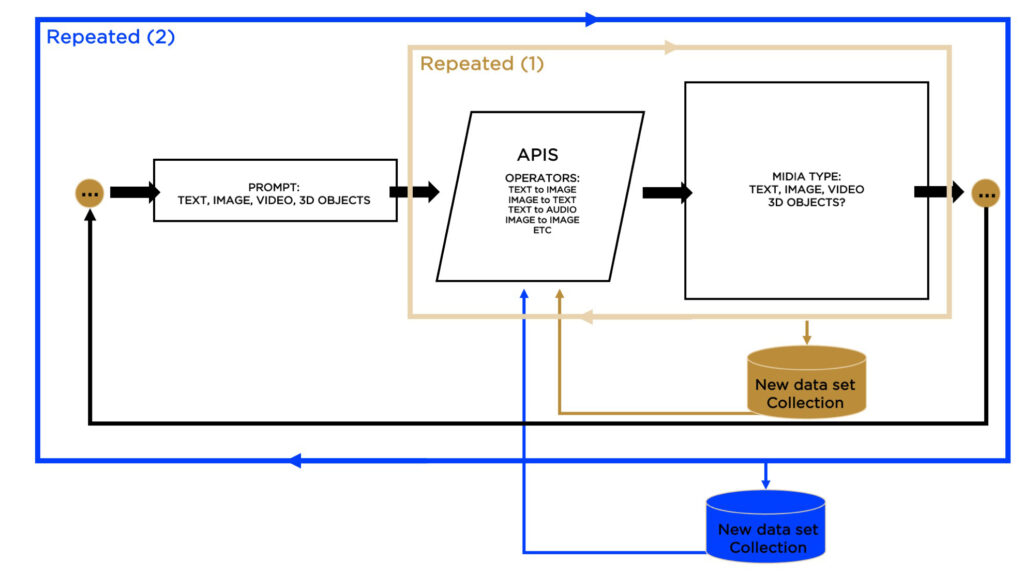

Modelos generativos transformaram o cenário da tecnologia criativa, introduzindo métodos inovadores que redefinem continuamente os limites artísticos. Um avanço crucial nesse campo é a integração de modelos em seus espaços de embedding, permitindo uma tradução fluida de texto para imagens e oferecendo um controle refinado sobre o resultado. Em nossos experimentos, adotamos uma abordagem simples: conectar a saída de um modelo generativo à entrada de outro, gerando diversos tipos de dados, como texto, áudio, imagem e vídeo, a partir de uma única entrada do usuário. Essas conexões formam um grafo direcionado de modelos, compondo um modelo multimodal [Figura 1]. Nossa prova de conceito inicial, que utiliza conexões fixas [Figura 5], estabelece a base para o desenvolvimento de uma ferramenta gráfica que permitirá aos usuários criar seus próprios modelos multimodais. Este é o projeto de uma ferramenta extraordinária para a criatividade.

1 INTRODUÇÃO

No cenário em constante evolução da arte digital, os modelos generativos multimodais ocupam uma posição de destaque na inovação, transformando a maneira como os artistas concebem e realizam suas visões criativas. Este artigo explora a interseção desses modelos generativos, onde elementos de texto, áudio, visuais e vídeo não são apenas justapostos, mas intrinsecamente entrelaçados para criar um novo léxico artístico. Ao investigar a fusão dessas modalidades, revelamos o imenso potencial para uma forma de arte digital mais sutil, dinâmica e expressiva. Essa síntese não apenas amplia o campo criativo, mas também desafia e redefine as noções tradicionais de criação artística, anunciando uma nova era na arte digital, em que os limites estão sendo constantemente reimaginados e ampliados. [Figura 1].

Este diagrama ilustra o processo iterativo em que um prompt do usuário inicia a criação de diversos tipos de mídia por meio de uma série de operações de API, culminando na formação de um novo conjunto de dados. O ciclo representado demonstra como textos, imagens, vídeos e, potencialmente, objetos 3D passam por transformações, destacando a capacidade do pipeline para uma geração expansiva de dados e refinamento iterativo.

2 OBJETIVOS

• Criatividade e Flexibilidade Ampliadas: Ao conectar diferentes tipos de modelos generativos (texto, áudio, imagem e vídeo), os usuários podem criar conteúdos complexos e multimodais a partir de uma única entrada. Essa abordagem amplia significativamente as possibilidades criativas, permitindo a geração de diversos resultados a partir de uma base conceitual consistente.

• Potencial para Estruturas de Modelos Geradas pelos Usuários: A ideia de uma ferramenta gráfica que permita aos usuários criar seus próprios modelos multimodais abre possibilidades para aplicações personalizadas e específicas. Isso pode levar a novas formas de interação com a IA e criação de conteúdo adaptadas às necessidades e preferências individuais.

• Desenvolvimento de um Grafo de Modelos Multimodais: O conceito de um grafo direcionado de modelos que compõem um modelo multimodal é inovador. Ele sugere um sistema interconectado onde a saída de um modelo alimenta diretamente a entrada de outro, criando um fluxo contínuo de transformação de dados.

• Exploração de Pipelines Multimodais no Metaverso: Investigar as capacidades de modelos generativos interconectados para criar um pipeline multimodal versátil no ambiente do metaverso. Essa exploração visa utilizar o poder da IA para transformar entradas únicas de usuários, ampliando o potencial imersivo e criativo de mundos virtuais. O objetivo inclui integrar modelos generativos de IA no UNITY Sentis para estabelecer um pipeline multimodal no metaverso, com foco especial no LunaPark Metaverse [VFXRio 2023]

(https://www.spatial.io/s/LunaPark-2-0-64cfeb874d4710ef26ea9066)

• Experimentação e Pesquisa: Do ponto de vista da pesquisa, essa abordagem oferece uma plataforma para explorar as relações entre diferentes tipos de dados e compreender como a informação é transformada entre modalidades.

• Simulação de Fluxo de Dados de IA: Examinar o impacto em modelos de dados que aprendem e reprocessam mídia sintética ao longo de múltiplas gerações.

• Ampliação do Escopo de Aplicações Criativas com IA: Impulsionar a integração da IA em diversos campos criativos, enfatizando o desenvolvimento de uma plataforma colaborativa multifacetada. Isso envolverá a criação de interfaces e ecossistemas inovadores onde a criatividade humana e a IA convergem, fomentando um terreno fértil para expressões artísticas inovadoras. O objetivo é aproveitar o poder adaptativo e gerativo da IA, transcendendo limites tradicionais para incluir jogos interativos, artes performativas e narrativas cocriativas dentro de experiências multimídia enriquecidas.

• Otimização da Criação de Conteúdo: Explorar diferentes tipos de dados para simplificar e aprimorar o processo de criação de conteúdo.

3. IMAGENS DE IA E DISCURSO FILOSÓFICO: WITTGENSTEIN + FOUCAULT

A interpretação perceptual da arte gerada por IA pode ser enriquecida ao contrastar perspectivas filosóficas, especialmente as de Wittgenstein e Foucault. A teoria dos "jogos de linguagem" de Wittgenstein [Wikipedia 2023a] [Wittgenstein 1953] enfatiza o contexto na linguagem, fundamental para a interpretação de prompts em IA, sugerindo que os significados evoluem com o uso contemporâneo. Isso se alinha diretamente aos prompts textuais ou visuais da IA, onde os significados mudam com base nos contextos linguísticos atuais. Paralelamente, a análise de Foucault sobre representação, como visto em sua interpretação da obra de Magritte "Ceci n’est pas une pipe" [Foucault 2008], ressalta a distinção entre realidade e sua representação, um fator crítico para compreender a arte gerada por IA. Juntas, essas filosofias oferecem uma estrutura abrangente para categorizar e compreender imagens geradas por IA, fundindo insights teóricos com avanços tecnológicos modernos.

4. A INTERAÇÃO DINÂMICA ENTRE ARTISTA, OBJETO DE ARTE E USUÁRIO NA IA: AS SINFONIAS INTERATIVAS

• O Artista como Artista-Observador: Na arte multimodal gerada por IA, o artista é tanto criador quanto participante ativo na experiência artística em evolução. Essa dualidade reflete a teoria dos jogos de linguagem de Wittgenstein, onde o significado e a interpretação de uma obra de arte, assim como a linguagem, não são fixos, mas evoluem através da interação e do contexto. O papel do artista-observador se assemelha à função da IA em modelos generativos, onde ela cria e modifica o conteúdo com base em entradas contínuas, borrando os papéis tradicionais de criador e observador.

• O Objeto de Arte Dinâmico: O objeto de arte na IA multimodal é comparável à interpretação de Foucault sobre a pintura de Magritte. Assim como a obra "Ceci n’est pas une pipe" [Wikipedia 2023b] desafia nossa percepção de representação versus realidade, o objeto de arte gerado por IA transcende os limites tradicionais. Ele não é apenas uma representação estática, mas uma entidade interativa e em evolução. Essa natureza dinâmica do objeto de arte na IA desafia as noções tradicionais de arte, espelhando os debates filosóficos sobre a natureza e o significado da linguagem e da representação.

• O Usuário como Participante Ativo: O papel do usuário nesse contexto é fundamental. Não mais apenas um observador passivo, o usuário torna-se um participante ativo na experiência artística. Suas interações com o objeto de arte influenciam diretamente sua evolução. Isso reflete a visão de Wittgenstein sobre a natureza contextual e dependente do uso da linguagem e do significado. Assim como o significado das palavras pode mudar com o uso e o contexto, o objeto de arte na IA muda e evolui com a interação do usuário, tornando a experiência artística altamente personalizada e variável.

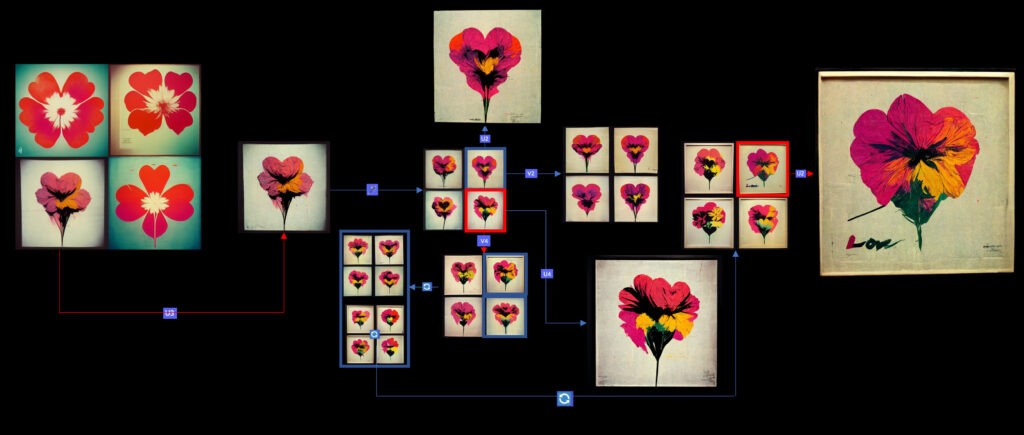

5. EXPERIMENTAÇÃO COM MIDJOURNEY

Esta sequência visual retrata a evolução generativa de imagens de flores inspiradas no estilo icônico de Andy Warhol, iniciada por um prompt no MidJourney. Refletindo processos genéticos, a série começa com formas florais básicas que, por meio de variações e combinações iterativas, apresentam características emergentes, como corações e elementos textuais. A iteração final, semelhante à manifestação rara de um gene recessivo, revela uma imagem complexa onde as flores formam um coração, acompanhado pela palavra "Love", simbolizando o ápice da jornada generativa.

A pesquisa começou com um experimento envolvendo o MidJourney (Versão 3, outubro de 2022), uma ferramenta de IA generativa sofisticada. Este modelo foi projetado para produzir um conjunto de quatro imagens em resposta a prompts textuais, demonstrando um nível avançado de fotorrealismo e profunda compreensão linguística. O framework procedimental (usando o MidJourney como um modelo multimodal IMAGE to IMAGE a partir de um ponto de partida textual específico) permite múltiplas interações com o conteúdo gerado. O usuário, ou "criador", tem a opção de solicitar um conjunto alternativo de quatro imagens (variações) ou selecionar uma imagem existente para "upscale" em resolução mais alta. Uma característica distintiva desse processo é a "evolução generativa," levando a um desenvolvimento interativo de uma imagem preferida [Figura 2]. Isso é alcançado aplicando duas funcionalidades principais:

• 'Variations' (V): solicita ao modelo a síntese de um novo conjunto de quatro imagens com base na fusão do prompt inicial.

• 'Upscale' (U): aumenta a resolução e o nível de detalhes de uma imagem gerada.

Nessa dinâmica interativa, a IA opera exclusivamente com entradas de um único prompt, contribuindo para a natureza evolutiva das imagens geradas. Esse processo é comparável à variação genética iterativa e à seleção. Por exemplo, na série intitulada "Love Machine," parte da coleção "I Want To Be a Machine" [Figura 2], observa-se a progressão evolutiva de uma imagem de flor. A série começou com um simples conjunto de quatro flores, que passaram por inúmeras transformações por meio de upscaling contínuo e modificações de variações, análogas à adição de informações genéticas e ao desenvolvimento de genes recessivos.

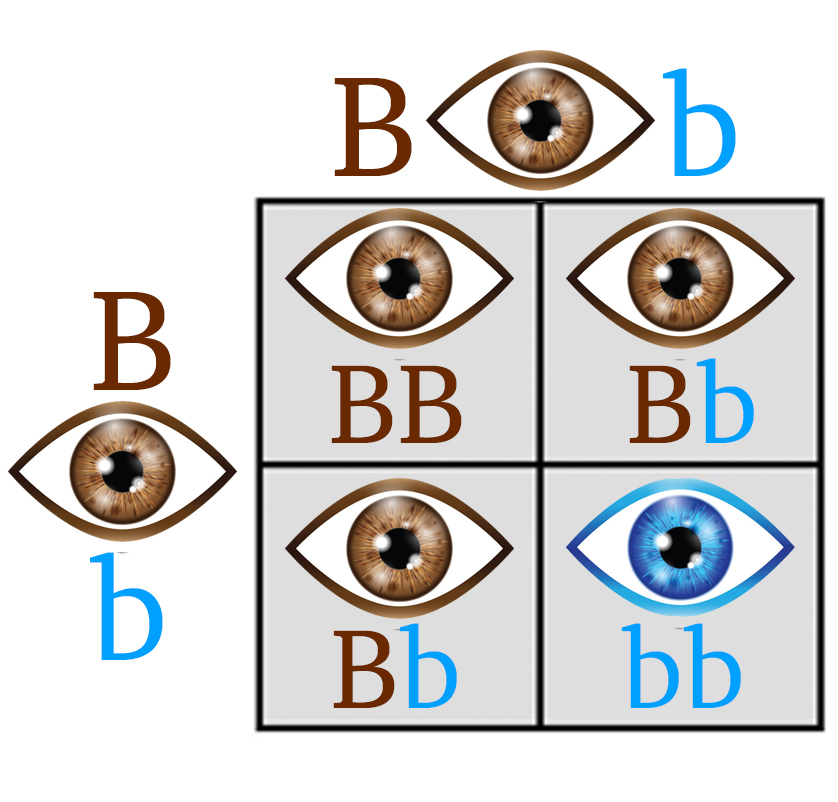

A evolução da imagem pode ser comparada a uma analogia genética, onde, por exemplo, o cruzamento de indivíduos de olhos castanhos (Bb x Bb) pode resultar em descendentes de olhos azuis recessivos (bb). Cruzamentos subsequentes dessa variante recessiva com uma família portadora de genes dominantes (bb x Bb) produzem descendentes diversos, espelhando a evolução baseada em prompts no modelo de IA. No caso da imagem da flor, esse processo resultou em um espectro de variações, culminando na incorporação de corações e da palavra "love" na iteração final, semelhante ao surgimento de traços inesperados em um cruzamento genético [Figura 3]. Esse estudo destaca a capacidade da IA para "evolução generativa," com o peso sintático do prompt sendo crucial. Ele encapsula as probabilidades de um modelo, instruções e parâmetros para a IA, guiando o desenvolvimento de elementos como corações e texto ("love") na sequência de imagens. A revelação da sintaxe exata do prompt seria, essencialmente, a exposição da "fórmula" por trás das transformações específicas da imagem, demonstrando como cada elemento do prompt contribui para o resultado visual final.

(a) Conjunto Generativo Inicial: Esta imagem, produzida pelo MidJourney em resposta a um prompt específico, apresenta um conjunto inicial de quatro flores distintas, reorganizadas para servir como um paralelo ilustrativo refletindo os estágios da evolução generativa impulsionada por IA, com uma clara referência à explicação baseada em DNA. Cada nova iteração exibia três espécimes dominantes ao lado de uma variante recessiva.

(b) Diagrama de Cruzamento Genético: Representando uma analogia genética, este diagrama ilustra o cruzamento de indivíduos de olhos castanhos que carregam um gene recessivo para olhos azuis (Bb x Bb), resultando em uma probabilidade de 1/4 de descendentes com olhos azuis (bb). Esse processo genético reflete o desenvolvimento do modelo de IA, onde cruzamentos iterativos resultam em características inesperadas, como o surgimento de corações e a palavra "love" na imagem final das flores, conforme mostrado na sequência gerada pela IA.

6. O PAPEL DO PROMPT

O prompt, nesse contexto, serve como uma chave específica que, quando inserida novamente, pode recriar variações semelhantes à imagem original. Isso é comparável ao uso de uma senha para acessar um conjunto de resultados relacionados, mas distintos.

7. MOTIVAÇÃO INICIAL PARA ESTA PESQUISA

A crescente prevalência de mídia sintética, particularmente arte gerada por IA, na internet, levanta implicações significativas:

• As AI art becomes more common, the role and impact of reprocessing synthetic media across multiple generations on data models, it will be added to the vast database of images of new data sets that was previously dominated by human-made creations. This influx of synthetic media could significantly alter the “noise” The concern is that future AI-generated art will be more influenced by previous

• AI creations than by original human artwork. This shift could have profound effects on the nature and quality of AI art and Human collective imagery. The model described in [Figure 1] can be used to simulate this process. These include the creation of data echo chambers, catastrophic forgetting, overfitting, feedback loops, degradation in creativity, and the impact of low-quality generated data. The right assessment would involve carefully considering these factors and developing new strategies.

7.1. O EFEITO MONA LISA PICASSO

Um exemplo desse impacto é a possível degradação das referências artísticas humanas ao longo do tempo. Quando a IA é instruída a criar algo como "Mona Lisa no estilo de Picasso," ela pode se basear cada vez mais em interpretações sintéticas do estilo de Picasso, em vez de suas obras reais, gerando saídas menos representativas do estilo original de Picasso [Figura 4].

Esta obra, produto da IA generativa do MidJourney e do upscaling de primeira geração, serve como um estudo fundamental no projeto de influxo de dados. Ela representa uma reinterpretação imaginativa da Mona Lisa, de Leonardo da Vinci, reestilizada no estilo abstrato e cubista de Pablo Picasso. Esta peça não é apenas uma fusão artística, mas também uma parte crucial da pesquisa inicial que explora o impacto do influxo de dados artísticos em conjuntos de dados sobre os resultados de modelos generativos.

8. O PRIMEIRO PIPELINE MULTIMODAL GENERATIVO: PROVA DE CONCEITO

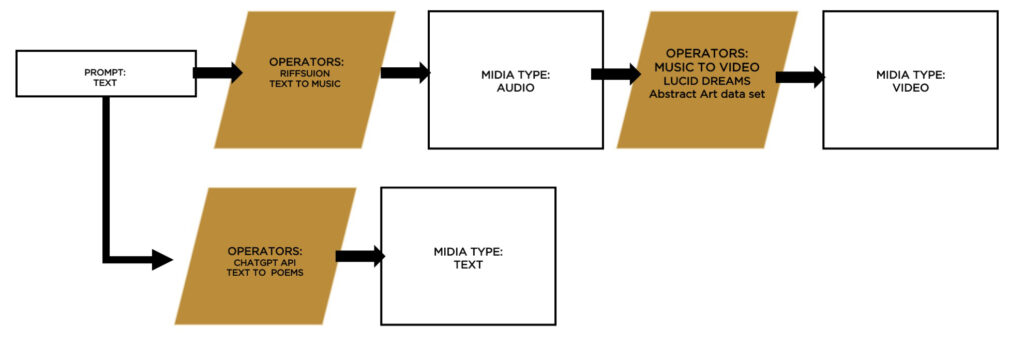

Nosso experimento de prova de conceito, que utiliza a sinergia de modelos generativos como Lucid Sonic Dreams, Riffusion e ChatGPT API, marca um avanço significativo na tecnologia criativa. Ele demonstra uma tradução fluida de texto para saídas variadas, como imagens, áudio e vídeo, por meio de um grafo interconectado de modelos.

Primeiras Experimentações: Fluxograma de Modelo Generativo Multimodal.

Este diagrama retrata a jornada transformacional de um prompt textual para um poema lírico utilizando a API do ChatGPT, que, por sua vez, inspira uma peça musical por meio das capacidades de texto para música do Riffusion. Subsequentemente, o áudio gerado serve como base para criar uma experiência visual através da operação de música para vídeo do Lucid Sonic Dreams, culminando em um vídeo de arte abstrata. Isso ilustra a capacidade da IA de transitar e transmutar entre diferentes tipos de mídia, incorporando a essência da criatividade generativa multimodal.

Lucid Sonic Dreams: Gera visualizações de vídeo a partir de música, sincronizando elementos percussivos e harmônicos. Por padrão, ele usa NVLabs StyleGAN2-ada, com modelos pré-treinados retirados do repositório consolidado de Justin Pinkney. Pesos personalizados e outras arquiteturas GAN também podem ser usados.[Pollinations.AI 2023] – fonte: (https://github.com/pollinations/lucid-sonic-dreams-pytorch#lucid-sonic-dreams).

- Riffusion: Cria riffs musicais utilizando imagens de espectrogramas geradas por Stable Diffusion v1.5, que são posteriormente convertidas em clipes de áudio.

Fonte: (https://github.com/riffusion).

ChatGPT API: Oferece processamento avançado de linguagem natural, contribuindo para o entendimento do impacto da IA na arte digital.https://openai.com/blog/introducing-chatgpt-and-whisper-apis).

9. CONCLUSÃO

Nosso estudo ilustra o impacto transformador dos modelos generativos multimodais na arte, anunciando uma nova era na interação entre inteligência artificial e expressão artística. Ele destaca as funções dinâmicas de "artista-observador," "objeto de arte" e "usuário," enquanto revela como ferramentas inovadoras e filosofias, como as de Wittgenstein e Foucault, moldam a nova paisagem da arte digital.

As implicações abrangem desde o design de algoritmos análogos ao DNA da arte digital até a consideração cuidadosa do uso de dados para preservar autenticidade, diversidade e originalidade no campo da arte gerada por IA.

Isso destaca a importância da pesquisa acadêmica contínua, especialmente na curadoria meticulosa de conjuntos de dados, para compreender e orientar o impacto da seleção de dados nos resultados artísticos.

Em conclusão, nosso estudo não apenas redefine paradigmas tradicionais de arte, mas também abre novos caminhos para futuras pesquisas sobre a intrincada relação entre tecnologia e arte. Ele enfatiza o potencial dos modelos generativos multimodais de explorar novos territórios na expressão artística, impactando profundamente a criação e a interpretação da arte. Estando na vanguarda de uma revolução da arte digital, nossa pesquisa sublinha a relevância da exploração acadêmica contínua, oferecendo insights críticos sobre a natureza em evolução da criatividade e da arte na era da IA.